목차

- 생성형 AI 기술 트렌드

1.1 생성형 AI의 기술적 진화

1.2 생성형 AI의 산업별 도입 현황

1.3 생성형 AI가 만들어낸 새로운 위협 벡터 - 보안 솔루션에 생성형 AI 적용 기술 트렌드

2.1 탐지 및 분석 영역의 AI 적용

2.2 대응 및 자동화 영역의 AI 적용

2.3 AI 시스템 자체 보안 (AI Security)

2.4 공격 시뮬레이션 및 레드팀 - 실질적인 시장의 변화

3.1 글로벌 AI 보안 시장 규모 및 성장 전망

3.2 주요 플레이어의 전략 변화

3.3 기업 보안 조직의 변화

3.4 규제 및 컴플라이언스 환경의 변화

들어가며

생성형 AI가 바꾼 사이버 위협의 지형

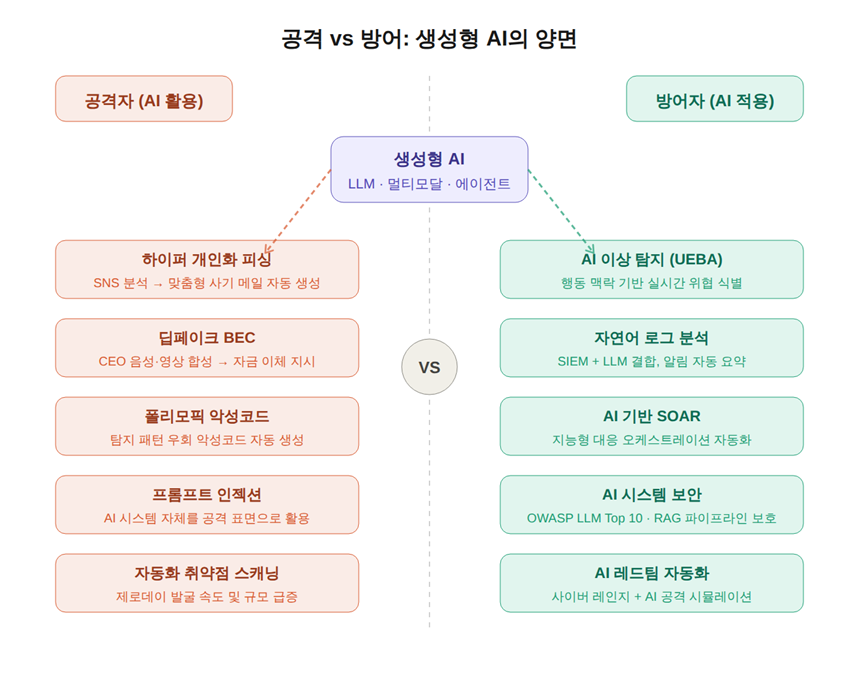

2022년 ChatGPT의 등장 이후 생성형 AI(Generative AI)는 인류의 생산성 도구를 근본적으로 재편하기 시작했다. 그러나 이 혁명적 기술은 동시에 사이버 위협 환경에도 전례 없는 변화를 가져왔다. 이제 해커는 정교한 피싱 메일을 단 몇 초 만에 무제한 생성할 수 있고, 딥페이크 음성을 활용한 CEO 사기(BEC: Business Email Compromise)는 탐지를 회피하며 진화하고 있다.

공격자의 진입 장벽이 낮아진 만큼, 방어자의 책임은 더 무거워졌다. 과거의 보안은 ‘알려진 위협’을 막는 것이었다. 하지만 생성형 AI 시대의 보안은 ‘아직 존재하지 않는 위협’에도 대응해야 한다. 이 보고서는 바로 그 변화의 중심, ‘공격’과 ‘방어’의 새로운 균형점을 탐색한다.

왜 지금 보안 패러다임을 다시 생각해야 하는가

“AI는 공격자에게 양적 우위를, 방어자에게 질적 도약의 기회를 동시에 제공한다. 문제는 어느 쪽이 먼저 그 기회를 잡느냐이다.”

기존 보안 패러다임의 핵심은 ‘경계 방어(Perimeter Defense)’였다. 방화벽, IDS/IPS, 그리고 시그니처 기반 탐지 엔진이 그 중심에 있었다. 하지만 클라우드 전환, 원격 근무의 확산, 그리고 생성형 AI의 등장은 이 경계를 무의미하게 만들었다.

특히 주목해야 할 세 가지 구조적 변화가 있다:

- 공격의 민주화: 기술 지식이 없어도 AI 도구만으로 정교한 사이버 공격이 가능해졌다

- 속도의 비대칭: 공격은 자동화로 초 단위로 이뤄지지만, 방어는 여전히 사람 중심의 시간이 걸린다

- 표면의 확장: AI 시스템 자체가 새로운 공격 표면이 되었다 — 프롬프트 인젝션, 모델 탈옥, 학습 데이터 오염 등

- 생성형 AI 기술 트렌드

1.1 생성형 AI의 기술적 진화

LLM의 발전: GPT, Claude, Gemini 등 주요 모델 동향

2024~2025년을 거치며 대규모 언어 모델(LLM)은 단순 텍스트 생성기를 넘어 ‘추론하는 AI’로 진화했다. OpenAI의 GPT-4o, Anthropic의 Claude 3 시리즈, Google의 Gemini Ultra는 각각 수백조 개의 파라미터를 기반으로 복잡한 논리 추론, 코드 생성, 다국어 처리 능력을 갖추었다.

특히 보안 관점에서 주목할 발전은 다음과 같다:

- 컨텍스트 윈도우의 확장: 초기 4K 토큰에서 100만 토큰 이상으로 확대되어 방대한 보안 로그 분석이 가능해짐

- 코드 생성 능력의 고도화: 취약점 탐지, 패치 제안, 보안 코드 리뷰 자동화에 직접 활용 가능

- 파인튜닝 및 RAG의 보편화: 기업 내부 보안 데이터 기반의 특화 모델 구축이 용이해짐

멀티모달 AI의 등장과 확산

텍스트를 넘어 이미지, 오디오, 비디오를 통합 처리하는 멀티모달 AI는 보안 환경에 양날의 검이다. 방어 측에서는 네트워크 트래픽 패턴의 시각적 분석, 악성 코드 이미지 분류 등에 활용된다. 반면 공격 측에서는 딥페이크 생성 비용이 급격히 낮아지고, 문서 위조와 신원 사기의 정교함이 극적으로 높아지고 있다.

2025년 기준 주요 멀티모달 보안 응용 사례:

- CCTV 영상의 실시간 위협 행동 탐지 (비정상 접근 패턴 인식)

- 스크린샷·문서 이미지 기반 피싱 URL 및 악성 콘텐츠 탐지

- 음성 인증 시스템 우회를 위한 딥페이크 음성 탐지

에이전틱 AI(Agentic AI): 자율 실행 에이전트의 부상

2025년 보안 업계에서 가장 뜨거운 키워드 중 하나는 ‘에이전틱 AI’다. 단순히 질문에 답하는 AI를 넘어, 스스로 목표를 설정하고 도구를 사용하며 작업을 완수하는 자율 에이전트가 등장했다. 이는 보안 자동화에 혁명적 가능성을 제공하지만, 동시에 AI 에이전트 자체가 해킹의 대상이 되는 새로운 위협 시나리오를 만들어낸다.

에이전틱 AI가 보안 영역에서 가져올 게임체인저: 자율적 위협 헌팅(Threat Hunting), 무인 인시던트 대응(Autonomous IR), 지속적 취약점 평가 자동화

1.2 생성형 AI의 산업별 도입 현황

생성형 AI의 산업 침투 속도는 분야별로 큰 차이를 보이며, 이는 보안 위협의 우선순위 결정에도 직접적인 영향을 미친다.

- 금융: 사기 탐지, 이상 거래 분석, 규정 준수 문서 자동화에 선도적으로 도입. AI 기반 금융 사기의 주요 표적이기도 함

- 의료: 진단 보조, 임상 기록 요약에 활용. 환자 데이터 프라이버시와 HIPAA 준수 이슈가 핵심 보안 과제

- 제조: 예지 보전, 품질 검사 자동화. OT/IT 통합 환경에서의 사이버-물리 보안이 부상

- 공공: 민원 처리 자동화, 정책 문서 분석. 국가 수준의 AI 인프라가 국가 지원 해킹(APT)의 표적으로 부상

특히 주목할 변화는 AI 활용 방식의 진화다. 초기에는 단순 ‘코파일럿(Copilot)’ 형태로 사람의 작업을 보조하는 수준이었으나, 점차 의사결정권을 일부 위임받는 자율화 단계로 이행하고 있다. 이 과정에서 AI에 대한 과도한 신뢰(Over-reliance)는 그 자체로 보안 취약점이 된다.

1.3 생성형 AI가 만들어낸 새로운 위협 벡터

AI 기반 사이버 공격의 진화

생성형 AI는 사이버 공격의 세 가지 핵심 요소인 속도, 정교함, 규모를 모두 혁신적으로 향상시켰다. 이제 단일 공격자가 수천 개의 맞춤형 스피어 피싱 메일을 자동 생성하고, 실시간으로 탐지 회피 기법을 업데이트하며, 취약점 스캐닝과 익스플로잇 시도를 자동화할 수 있다.

대표적인 AI 기반 공격 사례:

- 하이퍼-개인화 피싱(Hyper-personalized Phishing): SNS 프로필, LinkedIn 이력, 공개 정보를 LLM이 분석하여 대상자 맞춤형 피싱 메시지 생성

- 딥페이크 BEC: CEO나 CFO의 음성·영상을 합성하여 긴급 자금 이체를 지시하는 사기

- AI 생성 악성코드: 탐지 패턴을 학습하여 시그니처 기반 보안을 우회하는 폴리모픽 악성코드 자동 생성

- 자동화된 취약점 연구: 오픈소스 코드베이스를 LLM이 분석하여 제로데이 취약점 식별 속도 향상

AI 모델 자체를 겨냥한 공격

생성형 AI가 기업 시스템에 깊숙이 통합될수록, AI 모델 자체가 새로운 공격 표면으로 부상했다. 이는 기존 사이버 보안 교과서에는 없던 완전히 새로운 위협 범주다.

- 프롬프트 인젝션(Prompt Injection): 악의적 지시를 입력에 삽입하여 AI 시스템이 의도치 않은 행동을 하도록 유도. 특히 에이전틱 AI 환경에서 치명적

- 모델 탈옥(Jailbreaking): 안전 장치를 우회하여 제한된 콘텐츠나 정보를 AI로부터 추출

- 데이터 포이즈닝(Data Poisoning): 학습 데이터에 오염된 정보를 삽입하여 모델의 판단을 왜곡

- 모델 추출(Model Extraction): 반복적 쿼리를 통해 독점 AI 모델의 구조와 파라미터를 역공학

- 메모리 조작: 에이전트의 장기 기억(Long-term Memory)을 오염시켜 지속적 행동 조작

- 보안 솔루션에 생성형 AI 적용 기술 트렌드

2.1 탐지 및 분석 영역의 AI 적용

AI 기반 이상 탐지(Anomaly Detection) 고도화

전통적인 룰 기반(Rule-based) 탐지 시스템의 한계는 명확했다. 알려진 패턴만을 탐지하고, 새로운 공격 기법에는 속수무책이었다. 생성형 AI는 이 한계를 정면 돌파한다. 대규모 언어 모델은 정상 행동의 복잡한 맥락을 학습하고, 미묘한 편차를 기존 시스템보다 훨씬 정교하게 식별한다.

AI 기반 이상 탐지의 핵심 혁신:

- UEBA(User and Entity Behavior Analytics): 사용자의 로그인 시간, 접근 패턴, 데이터 사용량의 맥락적 이상을 AI가 실시간 분석

- 네트워크 트래픽 AI 분석: 패킷 헤더 정보뿐 아니라 트래픽 흐름의 시계열 패턴을 학습하여 C2(Command & Control) 통신, 데이터 유출 탐지

- 엔드포인트 행동 분석: 프로세스 실행 순서, 메모리 접근 패턴, 레지스트리 변경의 연관관계를 AI가 분석

자연어 기반 보안 로그 분석 및 SIEM 연동

기업 환경에서 하루에 생성되는 보안 로그는 수십~수백 GB에 달한다. 전통적인 SIEM(Security Information and Event Management) 시스템은 사전 정의된 룰로 이를 필터링했으나, 복잡한 APT 공격의 흔적은 대부분 ‘노이즈’에 묻혀 놓쳤다. 생성형 AI는 이 게임을 바꾼다.

- 자연어 쿼리: 보안 분석가가 SQL 대신 ‘지난 24시간 동안 외부 IP로 1GB 이상 전송된 사용자’처럼 자연어로 위협을 조회

- 자동 상관분석: 수십 개의 분산된 이벤트를 AI가 시간순으로 연결하여 공격 체인(Kill Chain) 자동 재구성

- 자동 알림 요약: 수천 개의 알림을 AI가 우선순위화하고 핵심 맥락과 함께 요약하여 SOC 피로도 감소

제로데이 취약점 자동 탐지 및 예측

생성형 AI를 활용한 취약점 연구는 방어자와 공격자 모두에게 새로운 지평을 열었다. Google의 Project Zero와 같은 엘리트 연구팀의 전유물이었던 제로데이 발굴이 AI 도구의 도움으로 점차 민주화되고 있다.

- AI 기반 코드 정적 분석: 수백만 라인의 오픈소스 코드를 LLM이 분석하여 패턴 기반으로 취약점 위치 예측

- 퍼징(Fuzzing) 자동화: AI가 효과적인 퍼즈 입력을 생성하여 코드 커버리지와 취약점 발견 효율성 향상

- 취약점 우선순위화: CVE(Common Vulnerabilities and Exposures) 데이터와 실제 익스플로잇 코드를 AI가 분석하여 실제 위험도 기반 패치 우선순위 제안

2.2 대응 및 자동화 영역의 AI 적용

SOAR와 생성형 AI의 결합

SOAR(Security Orchestration, Automation and Response)는 기존에도 반복적 보안 대응을 자동화하는 도구였다. 그러나 생성형 AI와 결합하면서 완전히 새로운 차원의 ‘지능형 대응 오케스트레이션’이 가능해졌다.

기존 SOAR가 미리 정의된 플레이북(Playbook)을 실행했다면, AI 기반 SOAR는 상황을 이해하고 적합한 대응 전략을 실시간으로 합성(Synthesize)한다. 이는 마치 숙련된 보안 전문가가 24시간 상황실에 앉아 있는 것과 같은 효과를 낸다.

자동화된 인시던트 리포트 생성 및 대응 플레이북 추천

보안 사고 발생 후 분석 보고서 작성은 숙련된 분석가가 수 시간을 투입해야 하는 고난도 작업이었다. 생성형 AI는 이 과정을 극적으로 단축한다:

- 사고 타임라인 자동 재구성: 분산된 로그, 알림, 엔드포인트 데이터를 AI가 통합하여 공격 흐름을 시간순 서사로 자동 작성

- 영향 범위 자동 분석: 침해된 계정, 시스템, 데이터를 AI가 자동으로 매핑하여 사고 범위 즉시 파악

- 규정 준수 보고서 자동화: GDPR, PIPA(개인정보보호법) 등 규제별 신고 의무 체크리스트를 AI가 자동 생성

AI 기반 취약점 패치 자동화

취약점 탐지와 패치 사이의 시간(Mean Time to Patch)을 최소화하는 것은 보안의 핵심 지표다. 생성형 AI 코드 어시스턴트는 이 간극을 혁신적으로 줄이고 있다. GitHub Copilot, Amazon CodeWhisperer 등의 도구는 이미 보안 취약 코드를 실시간으로 탐지하고 수정 코드를 제안하는 수준에 이르렀다.

2.3 AI 시스템 자체 보안 (AI Security)

“AI 보안(AI Security)은 더 이상 선택이 아닌 필수다. AI 시스템은 기업의 가장 중요한 자산인 동시에 가장 새로운 취약점이다.”

LLM 보안 가이드라인: OWASP Top 10 for LLM

전통적인 웹 보안의 기준점이었던 OWASP Top 10이 LLM 영역으로 확장되었다. 2024년 업데이트된 OWASP Top 10 for LLM Applications는 AI 보안의 표준 프레임워크로 자리 잡고 있다. 핵심 위협으로는 프롬프트 인젝션(1위), 민감 정보 노출(2위), 공급망 취약점(3위), 데이터와 모델 포이즈닝(4위), 과도한 권한 부여(5위) 등이 포함된다.

RAG 파이프라인의 보안 리스크

검색 증강 생성(RAG: Retrieval-Augmented Generation)은 기업 내부 데이터를 AI와 연결하는 핵심 아키텍처로 자리 잡았다. 그러나 RAG는 새로운 보안 리스크도 함께 가져왔다:

- 간접 프롬프트 인젝션: 검색된 외부 문서에 악의적 지시를 삽입하여 RAG 시스템을 조작

- 데이터 누출: 부적절한 접근 제어로 인해 권한 없는 정보가 RAG 응답에 포함

- 벡터 DB 오염: 임베딩 데이터베이스에 악성 벡터를 삽입하여 검색 결과 왜곡

AI 거버넌스와 모델 접근 제어

AI 거버넌스는 기술적 문제를 넘어 조직 정책과 프로세스의 문제다. 기업은 AI 시스템에 대한 명확한 접근 제어 정책, 모델 사용 감사 로그, AI 출력에 대한 인간 검토(Human-in-the-loop) 프로세스를 갖춰야 한다. 특히 고권한 시스템과 연동된 에이전틱 AI에는 최소 권한 원칙(Principle of Least Privilege)을 엄격히 적용해야 한다.

2.4 공격 시뮬레이션 및 레드팀

AI 기반 침투 테스트 자동화

침투 테스트(Penetration Testing)는 보안의 핵심 검증 활동이지만, 전통적으로 고도로 숙련된 전문가의 수작업에 의존했다. 생성형 AI는 이 분야에 자동화와 지능화의 물결을 가져오고 있다.

- 자동화된 정찰(Recon): 공개 정보(OSINT)를 AI가 수집·분석하여 공격 표면 자동 매핑

- 취약점 연쇄 분석: 개별 취약점들의 연쇄 익스플로잇 가능성을 AI가 자동으로 시뮬레이션

- 리포트 자동화: 발견된 취약점을 심각도, 비즈니스 영향, 권고 조치와 함께 구조화된 보고서로 자동 작성

사이버 레인지와 AI의 결합

사이버 레인지(Cyber Range)는 실제 환경을 모사한 사이버 훈련 환경이다. AI는 여기서 두 가지 역할을 한다. 첫째, 더 현실적이고 적응적인 공격 시나리오를 무한 생성하는 ‘지능형 레드팀 에이전트’로서의 역할이다. 둘째, 훈련 참가자의 대응 패턴을 분석하고 맞춤형 피드백을 제공하는 ‘AI 코치’로서의 역할이다. 이 결합은 보안 인재 양성의 속도와 효율을 극적으로 높이고 있다.

- 실질적인 시장의 변화

3.1 글로벌 AI 보안 시장 규모 및 성장 전망

AI 보안 시장은 사이버 보안 전체 시장에서 가장 빠르게 성장하는 세그먼트로 부상했다. 주요 리서치 기관들의 분석에 따르면, AI 기반 사이버보안 솔루션의 글로벌 시장 규모는 2024년 약 250억 달러에서 2030년까지 1,000억 달러를 초과할 것으로 전망된다. 연평균 성장률(CAGR) 약 25~30%는 전통적 사이버보안 시장 성장률의 3배에 달한다.

투자 집중 영역을 살펴보면:

- AI 기반 탐지 및 대응(AI-driven Detection & Response): 전체 AI 보안 투자의 약 35% 차지

- 클라우드 보안 + AI: 클라우드 인프라 보호에 AI를 통합한 솔루션

- AI 애플리케이션 보안: AI 시스템 자체를 보호하는 ‘Security for AI’ 영역의 급성장

- 생성형 AI 거버넌스 플랫폼: AI 사용의 리스크 관리와 컴플라이언스를 위한 새로운 제품 범주

3.2 주요 플레이어의 전략 변화

기존 보안 벤더의 AI 내재화 전략

크라우드스트라이크(CrowdStrike), 팔로알토 네트웍스(Palo Alto Networks), 센티넬원(SentinelOne) 등 기존 사이버보안 강자들은 생성형 AI를 기존 제품 깊숙이 내재화하는 전략을 선택했다.

대표적 사례:

- CrowdStrike: Charlotte AI를 통해 자연어 기반 위협 헌팅 및 인시던트 분석 기능 통합. Falcon 플랫폼 전반에 AI 기능 확장

- Palo Alto Networks: Cortex XSIAM에 AI SOC 기능 통합. ‘AI-powered security operations platform’으로 포지셔닝

- Microsoft: Copilot for Security를 통해 자사 보안 제품군(Defender, Sentinel) 전체에 GPT-4 기반 AI 인터페이스 도입

빅테크의 보안 시장 진입

Microsoft, Google, AWS는 AI 역량과 클라우드 인프라를 바탕으로 사이버보안 시장에서 존재감을 급속히 확대하고 있다. 이들의 전략적 우위는 압도적인 AI 연구 역량, 광범위한 고객 데이터 접근성, 그리고 보안 솔루션과 클라우드 인프라의 네이티브 통합이다. 전통적 보안 벤더들은 이를 실존적 위협으로 인식하고 있다.

AI 네이티브 보안 스타트업의 등장

전통적 보안 기업들이 AI를 ‘추가’하는 동안, AI를 기반으로 처음부터 설계된 ‘AI-native’ 보안 스타트업들이 빠르게 성장하고 있다. 이들은 레거시 코드베이스의 부담 없이 최신 AI 아키텍처를 100% 활용한다. Abnormal Security(이메일 보안), Orca Security(클라우드 보안), Darktrace(자율 대응) 등이 대표적이다.

3.3 기업 보안 조직의 변화

SOC의 역할 재정의

생성형 AI의 도입은 보안 운영 센터(SOC: Security Operations Center)의 역할과 구조를 근본적으로 재편하고 있다. 전통적 SOC는 알림(Alert) 수신 → 분류(Triage) → 분석(Analysis) → 대응(Response)의 선형 프로세스로 운영됐다. AI SOC에서는 이 과정의 Tier 1~2가 상당 부분 자동화된다.

이는 SOC 인력의 역할 재정의를 요구한다:

- 기존 역할의 축소: 단순 알림 처리, 로그 모니터링 등 반복적 작업은 AI가 대체

- 새로운 역할의 부상: AI 시스템 감독, 복잡한 위협 수사(Threat Investigation), AI 플레이북 설계·검증

- 하이브리드 SOC 모델: AI와 인간 분석가의 협업 체계 설계가 핵심 경쟁력

보안 인력 수급 문제와 AI 보조 도구

글로벌 사이버보안 인력 부족 문제는 수년째 심화되고 있다. ISC² 2024 보고서에 따르면 전 세계 사이버보안 인력 부족 규모는 약 400만 명에 달한다. 생성형 AI 기반 보조 도구는 이 문제의 부분적 해결책으로 주목받고 있다. 경험이 적은 분석가도 AI 어시스턴트의 도움으로 복잡한 위협을 분석하고 대응할 수 있는 ‘기술 민주화’ 효과를 기대할 수 있다.

CISO가 직면한 새로운 의사결정 과제

최고정보보안책임자(CISO: Chief Information Security Officer)의 역할은 AI 시대를 맞아 더욱 복잡해졌다. 기술적 보안 결정을 넘어 AI 도입의 리스크와 혜택을 균형 있게 평가하고, 이사회에 AI 보안 리스크를 비기술적 언어로 설명하며, AI 관련 규제 환경 변화에 선제적으로 대응해야 한다. CISO는 이제 기술 책임자이자 비즈니스 리스크 관리자이며 규제 전문가의 역할을 동시에 수행해야 한다.

3.4 규제 및 컴플라이언스 환경의 변화

글로벌 규제 동향

각국 정부는 AI가 가져오는 새로운 보안 위협에 대응하기 위해 규제 프레임워크를 빠르게 구축하고 있다. 규제의 방향은 크게 두 축으로 나뉜다. AI 시스템 자체의 안전성·투명성·책임성을 요구하는 ‘AI 규제’와, AI를 활용한 사이버 공격으로부터 인프라를 보호하는 ‘사이버보안 규제’다.

- EU AI Act (2024~2025 시행): 위험 등급별 AI 시스템 분류 및 규제. 고위험 AI 시스템에 대한 강력한 투명성·인간 감독 의무 부과

- 미국 AI 행정명령(EO 14110): AI 안전·보안 기준 수립. NIST AI Risk Management Framework와 연계

- 중국 생성형 AI 서비스 관리 방법: AI 생성 콘텐츠의 워터마크 의무화, 알고리즘 신고제 등

국내 AI·보안 관련 법제화 움직임

국내에서도 AI 보안 관련 법적 기반 구축이 가속화되고 있다. 개인정보보호법 개정을 통한 AI 데이터 처리 규범화, 정보통신망법 개정을 통한 AI 서비스 사업자 보안 의무 강화, 그리고 AI 기본법이 시행되었다. 특히 금융·의료 등 규제 산업에서는 AI 보안 의무 사항이 더욱 구체화되고 있다.

규제 준수와 보안 혁신 사이의 균형

역설적으로, 지나치게 엄격한 AI 규제는 방어자의 AI 활용을 억제하면서도 공격자의 AI 사용은 막지 못하는 불균형을 초래할 수 있다. 규제 당국이 직면한 핵심 과제는 ‘규제를 통한 AI 위험 최소화’와 ‘규제 과잉으로 인한 보안 역량 저하 방지’ 사이의 균형점 찾기다.

혁신적 규제 접근법으로 주목받는 모델: 규제 샌드박스(Regulatory Sandbox)를 통해 AI 보안 솔루션의 빠른 테스트와 검증을 허용하되, 명확한 가이드라인과 책임 체계를 함께 제공하는 방식

나가며

공격과 방어, AI 군비경쟁의 미래

사이버 공간의 역사는 언제나 공격과 방어의 군비경쟁이었다. 생성형 AI는 이 경쟁의 속도와 규모를 전례 없이 높였다. 지금 우리가 목격하는 것은 인류 역사상 가장 빠르게 진화하는 안보 환경이다.

한 가지 분명한 사실이 있다. 이 경쟁에서 AI를 외면하거나 두려워하는 쪽은 필연적으로 뒤처진다. 공격자들은 이미 AI를 전면 활용하고 있다. 방어자가 AI를 거부하는 것은 총을 든 상대에게 주먹으로 맞서는 것과 다름없다.

보안 솔루션이 나아가야 할 방향

AI 시대의 보안은 세 가지 원칙 위에 세워져야 한다.

- AI-first가 아닌 AI-augmented: AI는 인간 전문가를 대체하는 것이 아니라 증강해야 한다. 최종 판단과 책임은 인간에게 있어야 한다

- 보안의 민주화: AI 도구를 통해 고급 보안 역량이 중소기업과 개발도상국에도 확산되어야 한다. 보안의 불평등이 사이버 세계의 가장 큰 위험이다

- Trust by Design: AI 시스템은 처음부터 보안을 내재화해야 한다. AI 거버넌스, 투명성, 설명가능성은 선택이 아닌 기본 요건이다

생성형 AI 시대의 사이버 보안은 기술의 문제이기 이전에 신뢰의 문제다. AI가 우리의 디지털 인프라를 지키는 수호자가 될지, 아니면 그것을 허무는 파괴자가 될지는 결국 우리가 AI를 어떻게 설계하고, 배포하고, 감독하느냐에 달려 있다.

“AI의 가장 강력한 방어막은 또 다른 AI다. 그러나 그 AI를 설계하는 것은, 결국 인간이다.”

* Claude를 사용하여 작성한 보고서입니다.